Wenn Produktionssysteme rund um die Uhr laufen, müssen auch die Menschen dahinter jederzeit handlungsfähig sein. Genau dafür gibt es die Rufbereitschaft. Sie ist ein wichtiger Bestandteil des Betriebs und sorgt dafür, dass kritische Systeme auch außerhalb der regulären Arbeitszeiten zuverlässig unterstützt werden können. Die Realität hinter dem Diensttelefon 4:00 Uhr…

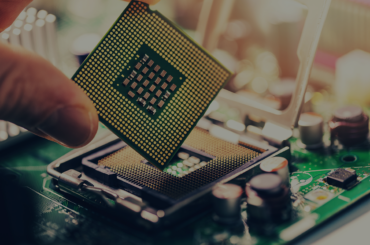

Interview der Blogredaktion mit Oracle-Lizenzexperte Michael Paege. Michael, es scheint, es gibt Neuigkeiten bei Prozessoren und Hardware-Architekturen im Hause Oracle?…

Vom Video-Call zur automatischen Zusammenfassungen für alle Teilnehmer Im Zuge der rasanten Entwicklungen von Künstlicher Intelligenz im Allgemeinen und Large…

In den letzten Monaten haben wir intensiv in einem Showcase Projekt im Rahmen des OC Public Digital Innovation Lab mit…